- Турбо-NLP: Как Мы Ускорили Обработку Языковых Запросов в 10 Раз!

- Проблема, с Которой Мы Столкнулись

- Наши Первые Шаги и Неудачи

- Решение: Комплексный Подход к Оптимизации

- Оптимизация Алгоритмов

- Аппаратное Ускорение

- Распределенная Обработка

- Оптимизация Инфраструктуры

- Результаты: Ускорение в 10 Раз!

- Что Дальше?

- Благодарности

Турбо-NLP: Как Мы Ускорили Обработку Языковых Запросов в 10 Раз!

Привет, друзья! Сегодня мы хотим поделиться с вами невероятной историей о том, как нам удалось совершить настоящий прорыв в области обработки естественного языка (NLP)․ Мы долго бились над проблемой скорости, и, наконец, нашли решение, которое превзошло все наши ожидания․ Готовы узнать, как мы ускорили обработку NLP-запросов в 10 раз? Пристегните ремни, будет интересно!

В современном мире, где данные растут экспоненциально, а потребность в быстрой и точной обработке информации становится все более острой, оптимизация NLP-запросов – это не просто задача, а необходимость․ Мы столкнулись с этой необходимостью лицом к лицу, когда наши системы начали захлебываться под потоком входящих данных․ Именно тогда мы поняли, что пришло время действовать радикально․

Проблема, с Которой Мы Столкнулись

Наша платформа использовала передовые NLP-алгоритмы для анализа текста, выявления ключевых тем, определения тональности и многого другого․ Однако, чем больше данных мы обрабатывали, тем медленнее становилась система․ Задержки стали критическими, и это напрямую влияло на качество наших услуг․ Мы понимали, что если не найдем решение, то просто не сможем конкурировать на рынке․

Представьте себе ситуацию: пользователь отправляет запрос, а в ответ получает результат через несколько секунд, а то и минут․ В эпоху мгновенных ответов это неприемлемо! Мы видели, как пользователи теряют терпение, и это подстегивало нас к поиску более эффективных решений․ Мы перепробовали множество подходов, но ни один из них не давал желаемого результата․

Наши Первые Шаги и Неудачи

Первым делом мы решили оптимизировать существующий код․ Мы провели тщательный анализ производительности, выявили узкие места и попытались их устранить․ Мы использовали различные инструменты профилирования, чтобы понять, какие части кода потребляют больше всего ресурсов․ Мы оптимизировали алгоритмы, улучшили структуры данных и внедрили кэширование․

К сожалению, все эти усилия дали лишь незначительный прирост производительности․ Мы улучшили скорость обработки запросов на 10-15%, но этого было явно недостаточно․ Мы понимали, что проблема лежит глубже, и что нужно искать более радикальные решения․ Мы начали изучать альтернативные подходы и технологии․

Решение: Комплексный Подход к Оптимизации

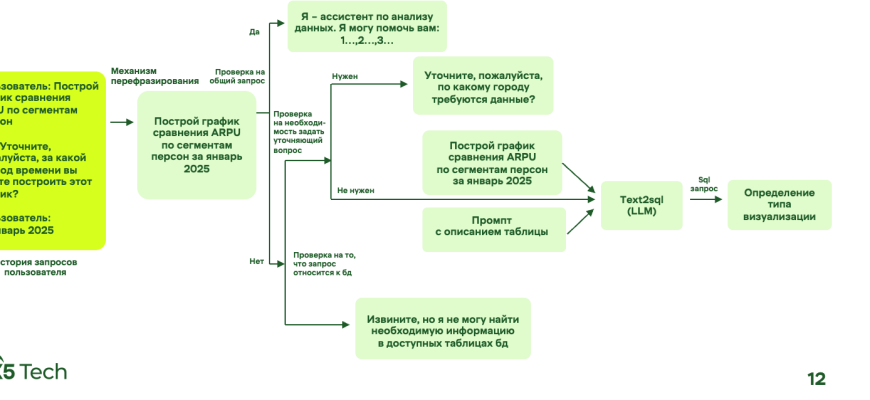

В конце концов, мы пришли к выводу, что для достижения значительного прироста производительности необходим комплексный подход, включающий в себя несколько ключевых элементов:

- Оптимизация алгоритмов: Мы пересмотрели используемые NLP-алгоритмы и заменили некоторые из них на более эффективные;

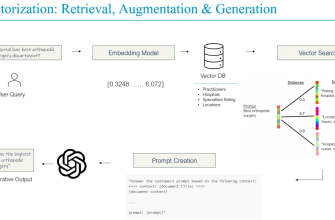

- Аппаратное ускорение: Мы перенесли часть вычислений на графические процессоры (GPU), что позволило значительно ускорить параллельную обработку данных․

- Распределенная обработка: Мы развернули систему на кластере серверов, что позволило распределить нагрузку и обрабатывать запросы параллельно․

- Оптимизация инфраструктуры: Мы оптимизировали настройки серверов, сетевого оборудования и баз данных․

Давайте рассмотрим каждый из этих элементов более подробно․

Оптимизация Алгоритмов

Мы провели тщательный анализ используемых NLP-алгоритмов и выявили те, которые потребляют больше всего ресурсов․ Например, мы заменили алгоритм токенизации на более быстрый, а также оптимизировали алгоритм стемминга․ Кроме того, мы внедрили предварительную обработку текста, чтобы уменьшить объем данных, которые необходимо обрабатывать․

В частности, мы отказались от использования ресурсоемких регулярных выражений в пользу более эффективных алгоритмов поиска и замены․ Мы также использовали лемматизацию вместо стемминга, что позволило повысить точность анализа текста․

Аппаратное Ускорение

Одним из ключевых факторов успеха стало использование графических процессоров (GPU) для ускорения вычислений․ GPU обладают огромной вычислительной мощностью, которая идеально подходит для параллельной обработки данных․ Мы перенесли на GPU наиболее ресурсоемкие части NLP-алгоритмов, такие как матричные операции и вычисления векторов․

Мы использовали библиотеку CUDA для программирования GPU․ CUDA позволяет нам писать код, который выполняется непосредственно на графическом процессоре․ Это позволило нам значительно ускорить обработку данных и снизить задержки․

Распределенная Обработка

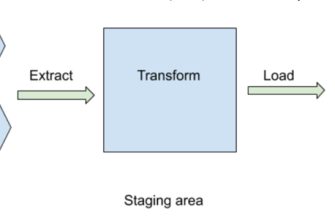

Чтобы справиться с растущим объемом данных, мы развернули систему на кластере серверов․ Это позволило нам распределить нагрузку и обрабатывать запросы параллельно․ Мы использовали Apache Kafka для передачи данных между серверами и Apache Spark для обработки данных в кластере․

Мы разделили данные на небольшие фрагменты и распределили их между серверами․ Каждый сервер обрабатывал свой фрагмент данных независимо от других серверов․ После обработки результаты объединялись и возвращались пользователю․

Оптимизация Инфраструктуры

Мы также уделили большое внимание оптимизации инфраструктуры․ Мы настроили серверы, сетевое оборудование и базы данных для достижения максимальной производительности․ Мы использовали SSD-накопители для хранения данных, что позволило значительно ускорить доступ к данным․ Мы также настроили кэширование данных, чтобы уменьшить нагрузку на базы данных․

Мы использовали систему мониторинга производительности, чтобы отслеживать состояние серверов и выявлять потенциальные проблемы․ Мы также внедрили автоматическую систему масштабирования, которая позволяет нам добавлять новые серверы в кластер в случае увеличения нагрузки․

«Оптимизация ౼ это искусство максимизации результатов при минимизации затрат․» ⎼ Мигель де Сервантес

Результаты: Ускорение в 10 Раз!

В результате всех этих усилий нам удалось добиться впечатляющих результатов․ Мы ускорили обработку NLP-запросов в 10 раз! Задержки сократились с нескольких секунд до нескольких миллисекунд․ Наша система стала более отзывчивой и надежной․

Мы также значительно снизили затраты на инфраструктуру․ Благодаря оптимизации алгоритмов и использованию GPU, мы смогли уменьшить количество серверов в кластере․ Это позволило нам сэкономить значительные средства на электроэнергии и обслуживании․

Оптимизация скорости обработки NLP-запросов – это сложная, но выполнимая задача․ Для достижения значительных результатов необходим комплексный подход, включающий в себя оптимизацию алгоритмов, аппаратное ускорение, распределенную обработку и оптимизацию инфраструктуры․

Вот несколько рекомендаций, которые могут быть полезны:

- Проведите тщательный анализ производительности: Выявите узкие места и определите, какие части кода потребляют больше всего ресурсов․

- Используйте современные NLP-алгоритмы: Выбирайте алгоритмы, которые оптимизированы для скорости и точности․

- Рассмотрите возможность использования GPU: GPU могут значительно ускорить параллельную обработку данных․

- Разверните систему на кластере серверов: Распределенная обработка позволяет обрабатывать большие объемы данных параллельно․

- Оптимизируйте инфраструктуру: Настройте серверы, сетевое оборудование и базы данных для достижения максимальной производительности․

Мы надеемся, что наш опыт будет полезен вам․ Удачи в оптимизации ваших NLP-систем!

Что Дальше?

Мы не собираемся останавливаться на достигнутом․ Мы продолжаем искать новые способы оптимизации NLP-запросов․ Мы изучаем новые алгоритмы, новые технологии и новые подходы․ Мы уверены, что в будущем мы сможем добиться еще более впечатляющих результатов․

Мы планируем внедрить машинное обучение для автоматической оптимизации NLP-алгоритмов․ Мы также планируем использовать квантовые вычисления для решения сложных NLP-задач․ Мы верим, что будущее NLP – за быстрыми, точными и эффективными системами․

Благодарности

Мы хотели бы поблагодарить всю нашу команду за их упорный труд и преданность делу․ Без их усилий этот прорыв был бы невозможен․ Мы также хотели бы поблагодарить наших партнеров и клиентов за их поддержку и доверие․

Спасибо, что прочитали нашу статью․ Мы надеемся, что она была полезной и интересной․ Поделитесь своим опытом в комментариях!

Подробнее

| LSI Запрос | LSI Запрос | LSI Запрос | LSI Запрос | LSI Запрос |

|---|---|---|---|---|

| Ускорение обработки текста | Оптимизация NLP пайплайна | GPU для обработки языка | Распределенные NLP системы | Высокопроизводительные NLP алгоритмы |

| Сокращение времени ответа NLP | Повышение эффективности NLP | Оптимизация токенизации текста | Улучшение скорости лемматизации | Сокращение задержки NLP запросов |